*Escrito por Wendy Rayón Gara.

18.09.2025 /Cimac Noticias.com/ Ciudad de México.- De acuerdo con el buscador de Google, existen 734 mil resultados con información para encontrar o generar material pornográfico a través del uso de inteligencia artificial. Estos sitios prometen herramientas avanzadas de edición para no solo modificar el cuerpo de las mujeres como ya ocurría con las deepfakes sexuales, sino crear escenas con diálogos personalizados a costa de la cosificación que dan cabida a la elaboración de pornomontantajes.

Siguiendo los datos del informe «Estado de deepfakes. Realidades, amenazas e impacto» de Security Hero.io, se reportó que una de cada tres herramientas deepfake permite a los usuarios crear pornografía gracias a la disponibilidad de herramientas, sofware y comunidades que son de acceso gratuito y fáciles de usar. Anteriormente se requería de experiencia técnica para alterar una imagen que mantuviera realismo; sin embargo, ahora existen más de 42 herramientas de este tipo con 10 millones de búsquedas mensuales.

«Ahora toma menos de 25 minutos y cuesta $ 0 crear un video pornográfico deepfake de 60 segundos de cualquier persona usando solo una imagen de rostro clara» -Security Hero.

Entre los hallazgos se encontró que la pornografía creada con inteligencia artificial representa el 98% de todos los videos deepfake en línea, esto demuestra que su distribución está relacionada con la creación de video de contenido sexual no consentido con la intención de difamar, violentar y denigrar.

En 2023 se encontraron 95 mil 820 videos pornográficos deepfake que representaron un aumento de 550% respecto a 2019. El crecimiento exponencial indicó una rápida proliferación de la tecnología para su creación, ya que 7 de cada 10 sitios de pornografía alojan este material con un total de 303 millones 640 mil 207 visualizaciones y un tráfico mensual de 34 millones 836 mil 914 de tan solo10 populares sitios

Security Hero.io señala que el género juega un importante papel en la selección de personas para manipular el contenido deepfake, ya que el 99% de este material presentan a las mujeres como sujetos principales y solo el 1% a los hombres. Por otro lado, el 48% de los varones estadounidenses encuestados visitaron estos sitios al menos una vez en su vida y el 74% no se sintió culpable por ello.

A nivel global, las principales nacionalidades que abundan en las mujeres expuesta son de Corea del Sur, Estados Unidos, Japón, Inglaterra, China, India, Taiwán e Israel que se relacionan con tensiones geopolíticas o estereotipos culturales. El 94% de ellas trabajan en la industria del entretenimiento, principalmente como cantante, actriz, creadora de contenido, modelo o aleta. El informe indica que esto puede deberse a que sus rostros son más reconocibles dentro del público general.

Los deepfakes y su funcionamiento

La palabra deepfake está conformada por la combinación de los conceptos deep learning (aprendizaje profundo) y fake (falso). Se refiere a la generación de contenido por una red neuronal artificial y es una rama del maching learning (aprendizaje automático) para crear contenido falso, pero realista. El término emergió en 2017, cuando un internauta subió a la red un video pornográfico donde el rostro de la actriz fue cambiado por el de una celebridad.

Desde entonces, se volvió popular la elaboración de deepfakes con el rostro de cualquier persona; sin embargo, los de mayor incidencia fueron usados sobre las mujeres. Su utilización en este tipo de contenido rompe cualquier barrera: niñas, adolescentes, jóvenes, mujeres adultas, indígenas, afrodescendientes hasta personalidades con poder como celebridades, funcionarias y hasta mandatarias.

Según información de la tesis “Violencia contra las mujeres en la Era Digital: la amenaza de los Deepfakes”, la tecnología detrás de la alteración de imágenes y videos es una red neuronal que aprende y copia las características de las imágenes originales para formar nuevo material con contenido falso e hiperrealista.

La autora de este texto, Viridiana Cuevas Orta apunta a que existen tres principales modelos: autoregresive model, que examina pixel por pixel; autoenconder, que codifica los datos de entrada de una versión y decodifica una versión lo más parecida posible; y generative adversarial network, que usa una red discriminadora como un filtro para perfeccionar que el material generado no se diferencie entre lo real y lo falso.

En consecuencia, el contenido pornográfico producido puede manifestarse a través de diferentes deepfakes como la manipulación de las expresiones faciales para imitar a otra persona, intercambio de caras y cuerpos, recreación de audios que simulan la voz de alguien o la creación de rostros humanos que no existen.

A partir del descubrimiento de las deepfakes, la mayoría de las advertencias sobre los riesgos se dirigen a los daños en la opinión pública y la desinformación invisibilizando la violencia generada contra las mujeres, sobre todo cuando el contenido es sexual.

«Esta práctica convierte, en este caso, a las mujeres en objetos de entretenimiento sexual contra su voluntad, causando una intensa angustia, humillación y daño a su reputación» -Viridiana Cuevas Orta

Un ejemplo de ello son las modelos, creadoras de contenido o actrices de pornografía creadas con inteligencia artificial. Pese a no ser personas reales, tienen muchos seguidores en redes sociales y se caracterizan por tener cuerpos delgados, piel blanca, facciones hegemónicas, y proporciones sexualizadas de su pecho y glúteos. Al igual que las celebridades, estas figuras mantienen contratos millonarios con marcas y empresas.

Un caso de cientos es el de Aitana López, quien es una supuesta creadora de contenido en España pero en realidad fue una creación digital de la agencia barcelonesa The Clueless, cuenta con más de 379 mil seguidores en su cuenta de Instagram. De acuerdo con su biografía, hace ejercicio, juega videojuegos y se dedica a viajar por el mundo. Aunque es utilizada con fines de marketing generando ganancias de 10 mil euros mensuales, se ha usado la misma estrategia para obtener dinero con deepfakes sexuales.

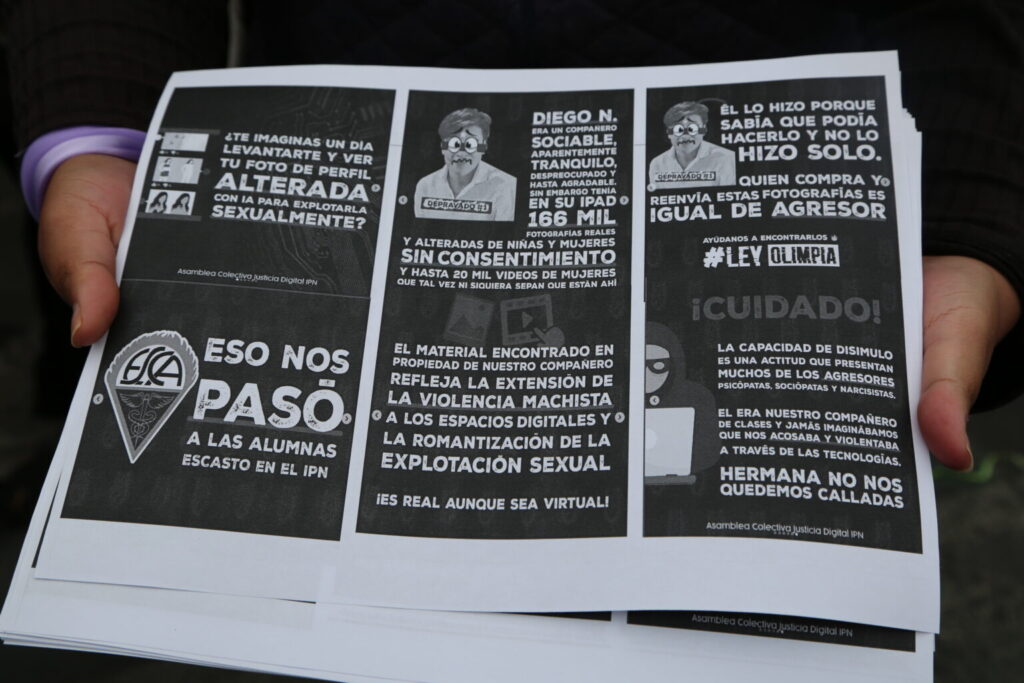

Uno de los casos más representativos en el país y en el mundo fue el de las 8 estudiantes de la Escuela Superior de Comercio y Administración (ESCA) del Instituto Politécnico Nacional en la Ciudad de México. El pasado 6 de octubre de 2023, denunciaron a uno de los estudiantes, Diego N., por vender deepfakes sexuales elaboradas con inteligencia artificial y no consensuadas a través de Telegram. En su tableta electrónica se hallaron 20 mil videos y 166 imágenes tomadas ilegalmente o por medio de redes sociales.

Alumnas del IPN denuncian red estudiantil de tráfico de imágenes – cimacnoticias.com.mx

El 9 de marzo de 2024 el estudiante fue vinculado a proceso por la Fiscalía General de Justicia de la Ciudad de México, en diciembre de 2024 el juez Francisco Salazar Silva lo absolvió en el caso de dos de las alumnas tras determinar que no se podía acreditar que el dispositivo electrónico donde se halló el material, le perteneciera.

Con esto se perdió la oportunidad de otorgar la primera sentencia por la creación y distribución de deepfakes de contenido pornográfico en México. No obstante, el pasado 21 de mayo de 2025, sentenciaron a Diego N. en el reclusorio Oriente por el delito de pornografía infantil en un proceso apartado de la denuncia de las estudiantes. La nueva denuncia fue interpuesta en abril de 2025 dónde la víctima fue una menor de edad.

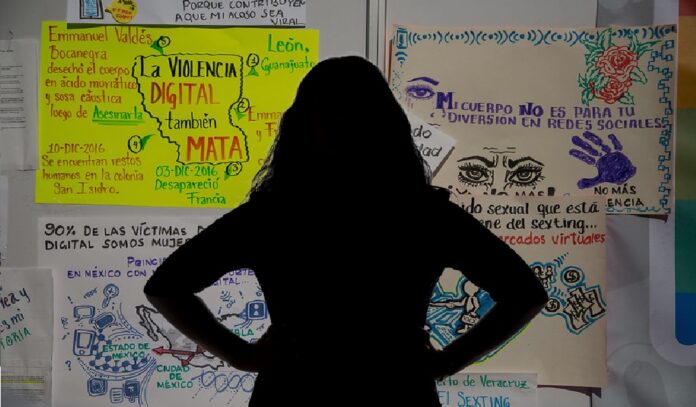

Si bien, la Ley Olimpia, significa un paso importante hacia el reconocimiento y sanción de la violencia sexual digital en el ámbito legislativo, este tipo de disposiciones aún son insuficientes si no van acompañados de una transformación cultural y de mecanismos integrales de prevención, atención y justicia.

Ley Olimpia, por ejemplo, nació como respuesta a un caso emblemático de violencia digital: la difusión masiva y no consentida de un video íntimo de la creadora de esta ley en el estado de Puebla, México. Tras un camino de denuncia y organización, la defensora logró impulsar una iniciativa para reformar el Código Penal en el estado y tipificar las conductas como violación a la intimidad.

De esta forma se estableció que la violencia sexual digital es:

«Toda acción dolosa realizada mediante el uso de tecnologías de la información y la comunicación, por la que se exponga, distribuya, difunda, exhiba, transmita, comercialice, oferte, intercambie o comparta imágenes, audios o videos reales o simulados de contenido íntimo sexual de una persona sin su consentimiento, sin su aprobación o sin su autorización y que le cause daño psicológico, emocional, en cualquier ámbito de su vida privada o en su imagen propia» según lo establece la Ley General de Acceso de las Mujeres a una Vida Libre de Violencia.

Asimismo, algunas conductas que atentan contra la intimidad sexual son: video grabar, audio grabar, fotografiar o elaborar videos reales o simulados de contenido sexual íntimo, de una persona sin su consentimiento o mediante engaño, así como exponer, distribuir, difundir, exhibir, reproducir, transmitir, comercializar, ofertar, intercambiar y compartir imágenes, audios o videos de contenido sexual íntimo de una persona, a sabiendas de que no existe consentimiento, mediante materiales impresos, correo electrónico, mensajes telefónicos, redes sociales o cualquier medio tecnológico.

No obstante, persiste un sistema capitalista y patriarcal que genera las condiciones para la existencia de este material, sin importar el avance legislativo en los Estados, permitiendo la existencia de pornomontajes en donde cualquier mujer -sin importar su etnia, aspecto físico, recursos económicos, escolaridad o popularidad- puede ser víctima.